一、评价指标

- 准确率(Accuracy):准确率是最常用的评价指标之一,它表示模型在测试集上的分类准确率。准确率的计算方法是将预测正确的样本数除以总样本数。

- 精确率(Precision):精确率是指分类器预测为正类的样本中,实际为正类的样本占预测为正类的样本的比例。精确率的计算方法是将真正类数除以真正类数加上假正类数。

- 召回率(Recall):召回率是指实际为正类的样本中,分类器预测为正类的样本占实际为正类的样本的比例。召回率的计算方法是将真正类数除以真正类数加上假负类数。

- F1分数(F1 Score):F1分数是精确率和召回率的调和平均数。F1分数越高,说明模型的性能越好。F1分数的计算方法是2 * (precision * recall) / (precision + recall)。

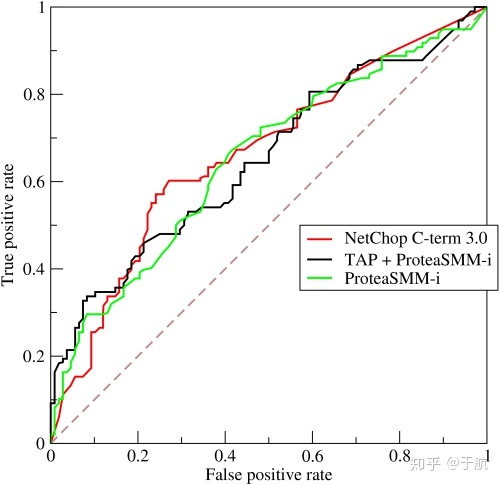

- ROC曲线和AUC值:ROC曲线是二分类问题中常用的评价指标,它可以用来比较不同模型的性能。ROC曲线是将分类器在不同阈值下的真正类率(TPR)和假正类率(FPR)绘制出来的曲线。AUC是ROC曲线下面积,它可以用来表示模型的整体性能。AUC也可以理解为分别随机从政府样本集中抽取一个正负样本,正样本的预测值大于负样本的概率。

- 损失函数(Loss Function):损失函数是用来评估模型在训练数据上的误差大小。训练模型的过程就是最小化损失函数的过程。常见的损失函数有交叉熵损失函数、均方误差损失函数等。

- 学习曲线(Learning Curve):学习曲线是指模型在不同训练集大小下的训练误差和测试误差的变化曲线。学习曲线可以用来评估模型是否存在过拟合或欠拟合的问题,从而选择最优的模型。

- 混淆矩阵(Confusion Matrix):混淆矩阵是用来评估分类器在不同类别上的表现。混淆矩阵的每一行代表真实的类别,每一列代表预测的类别。通过混淆矩阵可以计算出准确率、精确率、召回率等指标。

- 平均精度(Average Precision):平均精度是指分类器在不同类别上的平均精度值。平均精度通常用于计算目标检测或图像分割任务中的性能。目标检测中mAP的计算方法 - 知乎 (zhihu.com)

- KS:用于模型风险区分能力进行评估,指标衡量的是好坏样本累计分部之间的差值。

- Lift:衡量的是模型对目标变量的响应能力相对于随机选择的提升倍数。

- PSI指数:群体稳定性指标PSI(Population Stability Index)是衡量模型的预测值与实际值偏差大小的指标。可以评估模型预测能力的稳定性,也可以评估特征(分bin后不同bin群样本分布的稳定性)在不同的数据集分布稳定性。

注意:

这些评价指标的选择要根据具体问题和应用场景来决定,同时还需要考虑模型的可解释性、泛化性、速度等因素。通常在选择评价指标的时候,需要综合考虑多个指标,而不是仅仅考虑一个指标。

以上指标的原理都是用来评估模型在训练数据集上的性能,从而选择最佳的模型。不同指标的选择要根据具体的问题和应用场景来决定。例如,对于二分类问题,可以使用准确率、精确率、召回率、F1分数和ROC曲线等指标来评估模型性能;对于多分类问题,可以使用混淆矩阵、准确率和F1分数等指标来评估模型性能。

二、应用场景和对应的评价指标

- 分类问题:准确率、精确率、召回率、F1值、AUC-ROC等。

- 回归问题:均方误差、均方根误差、平均绝对误差、R2得分等。

- 目标检测问题:平均精度、召回率、平均定位误差、漏检率等。

- 图像分割问题:像素准确率、像素精确率、像素召回率、像素F1值、IOU等。

- 文本生成问题:困惑度、BLEU得分、ROUGE-L得分、METEOR得分等。

- 风险问题:

三、原理简介

-

准确率:分类正确的样本数除以总样本数。

-

精确率:指的是在所有被分类为正例的样本中,真正为正例的样本所占的比例。在目标检测中,Precision就是检测出来的框的数目(或者是面积吧),除以一共画出来的框。注意,在目标检测中:

True Positive区域:与Ground truth区域的IoU>=0.5的 False Positive区域:IoU < 0.5的

-

召回率:指的是在所有实际为正例的样本中,被分类为正例的样本所占的比例。在目标检测中,Recall就是预测出来的正确的框,除以正确的框再加上没有预测出来的ground truth的框。

-

F1值:是精确率和召回率的调和平均值,综合反映了分类器的性能。

-

AUC-ROC:ROC曲线下的面积,表示分类器将正例排在负例前面的能力。AUC也可以理解为分别随机从政府样本集中抽取一个正负样本,正样本的预测值大于负样本的概率。

-

均方误差:预测值与真实值之间差值的平方的均值。

-

均方根误差:均方误差的平方根,反映了预测值和真实值之间的平均差距。

-

平均绝对误差:预测值与真实值之间差值的绝对值的平均值。

-

R2得分:R2得分描述了模型对于总方差中可解释部分的解释程度,取值范围为0到1。

-

IOU:交并比,表示预测的区域和真实区域的交集与并集的比例。

-

NMS:非极大值抑制,对于目标检测问题,为了提高召回率,在模型计算中间过程会生成许多候选框(bounding box),使用NMS从堆叠的边框中挑出最好的一个。

-

fps:检测器每秒能处理图片的张数

-

FLOPs:检测器处理每张图片所需要的浮点操作数

-

mAP@50:m是不同类别AP50的均值

AP50的定义:(50的含义是iou阈值 为0.5)

已知: 所有测试集图片中某一类目标, 有m个标签真实框(框坐标);n 个预测宽(置信度+框坐标)

若: ① 预测框与真实框的IOU大于IOU_T(=0.5),则这个样本为真正例TP += 1;

② 如果小于阈值,则没框上的标签框导致 FN += 1,框错的预测框导致FP += 1

在这基础上,使用置信度Score划拉预测框的个数,计算PR曲线上的点,根据曲线下的面积算AP值。 ——————————————————————————— 准确率: P = TP / P 正确识别 / 总预测

召回率:R = TP / TP+ FN 正确识别 / 总真实 ————————————————

评价指标的选择要根据具体的应用场景和任务需求,不同的指标能够从不同角度反映模型的性能。因此,在模型评估和比较时,需要根据实际需求进行综合考虑。